Gizmodo Brasil |

- O consumo de podcasts está crescendo, e o Spotify quer ser o YouTube deste ramo

- Problema do “falso horário de verão” pode se repetir no dia 2 de novembro

- Quatro indicações para você que está pensando em começar o seu próprio negócio

- Mais evidências sugerem que a moda neandertal incluía garras de águia

- Twitter diz que só vai sinalizar conteúdo abusivo se a denúncia for feita pela pessoa afetada

- Uma olhada de perto no Deep Fusion, o novo recurso de câmera do iPhone 11

- Google confirma aquisição da fabricante de pulseiras inteligentes Fitbit por US$ 2,1 bilhões

- Pesquisadores usam inteligência artificial para criar personagens de videogame que se movem de maneira mais realística

- Serviço de streaming Apple TV+ já está disponível por R$ 9,90, com teste grátis de 7 dias

- Samsung coloca telas QLED em novos notebooks da linha Galaxy Book

- Pesquisa mostra que um embrulho mal-feito vai fazer a pessoa gostar mais do seu presente

| O consumo de podcasts está crescendo, e o Spotify quer ser o YouTube deste ramo Posted: 01 Nov 2019 03:12 PM PDT  Você curte podcasts? Eu curto, mas tenho a consciência de que não é todo mundo que escuta. Dados do Ibope mostram que 4 entre 10 internautas brasileiros já ouviram podcast alguma vez na vida. Além disso, o Spotify informa que a audição dos programas cresce 21% mensalmente desde janeiro de 2018. Mas quanto é isso? O Spotify não divulga publicamente o número (e praticamente ninguém da indústria), mas a empresa pelo menos fala em "dezenas de milhões de pessoas" já ouvindo os podcasts no mundo. É complicado falar com muita certeza do tamanho deste mercado. O setor é bem fragmentado entre diversos tocadores, o que pode, às vezes, dificultar a análise da audiência, mas, por outro lado, isso dá mais opções para os ouvintes. Mesmo assim, dados de diferentes instituições mostram que tem havido uma movimentação forte no Brasil. Segundo a pesquisa Soundcast Stats Soundbites, feita pela empresa que desenvolve o plugin PowerPress, que ajuda a distribuir podcasts para diferentes plataformas, o Brasil é o segundo maior país com download de podcasts, com 110 milhões de downloads no ano de 2018. A título de comparação, o líder são os Estados Unidos, com mais de 660 milhões de downloads no ano. A Deezer — que, para ser justo, foi a primeira plataforma de streaming a oferecer o serviço de podcasts no Brasil, em 2015 — também mostra certo crescimento no gênero neste ano. Em um levantamento recente, a companhia fala que o consumo de podcasts no serviço subiu 177% no Brasil nos últimos 12 meses. Apesar do não detalhamento de informações, o fato é que o Spotify quer ser uma espécie de "YouTube dos podcasts" (ou a "Casa dos podcasts", como eles falam nas propagandas deles). Pelo menos foi isso o que deu para concluir no evento Spotify for Podcasters Summit, realizado em São Paulo nesta sexta-feira (1º). Para ser o player número um das pessoas, a companhia tem investido em algumas produções feitas em parceria com veículos de imprensa, como a Folha de S. Paulo, com o Café da manhã. Este evento para reunir a comunidade, discutir o tema e trocar experiências é mais uma iniciativa nessa linha. Além disso, a empresa vem investindo em publicidade desde 2018 para falar da funcionalidade e tentar ser o tocador principal dos programas. Nessa briga por destaque, o Spotify está investindo para conseguir esse protagonismo, e a empresa diz que é líder na América Latina. No entanto, hoje, o mercado de podcasts está com menos cara de YouTube e com mais cara de plataformas de streaming de filmes e séries — que caminham lentamente para uma grande concorrência e fragmentação. A Apple está nessa há anos, o Google também tem um player próprio, e há uma série de outros tocadores independentes bons e com muitos ouvintes, como PlayerFM, Overcast e Pocket Casts, que mudou recentemente seu modelo de negócios. Teremos um grande vencedor nessa batalha? The post O consumo de podcasts está crescendo, e o Spotify quer ser o YouTube deste ramo appeared first on Gizmodo Brasil. |

| Problema do “falso horário de verão” pode se repetir no dia 2 de novembro Posted: 01 Nov 2019 03:02 PM PDT  As recentes mudanças no horário de verão, que não será adotado esse ano, podem deixar alguns eletrônicos confusos. Isso já aconteceu no último dia 20 de outubro, quando celulares adiantaram seus relógios em uma hora sem necessidade. E isso pode se repetir na passagem do dia 2 para o dia 3 de novembro, de acordo com o Google. O problema pode acontecer de novo por causa de uma medida adotada em 2017 pelo então presidente Michel Temer. Na ocasião, ele assinou um decreto determinando o início do horário de verão de 2018 no primeiro fim de semana de novembro. Isso foi uma mudança em relação ao que ocorria anteriormente: o horário de verão costumava começar no terceiro fim de semana de outubro. Já em 2018 isso deu problema, e alguns aparelhos mudaram de horário ainda em outubro daquele ano, seguindo as antigas diretrizes. Este ano, não teremos horário de verão por causa de uma decisão do presidente Jair Bolsonaro. Mesmo assim, o “falso horário” já deu as caras na madrugada do dia 20 para o dia 21 de outubro, e isso pode acontecer de novo neste sábado (2). Explicamos em 2018 por que isso ocorre: basicamente, existe uma tabela chamada TZ, que traz instruções de horários de verão para países de todo o mundo. A atualização dela, porém, depende de fabricantes, e alguns não fizeram a lição de casa. Seja como for, existe um jeito simples de você evitar isso: entre nas configurações do seu smartphone, procure os ajustes de data e hora e desative a opção de fuso horário automático e a opção de data e hora automáticas. O Google recomenda que você mantenha as coisas desse jeito até 16 de fevereiro de 2020, quando o horário de verão, se tivesse sido adotado, deveria terminar. The post Problema do “falso horário de verão” pode se repetir no dia 2 de novembro appeared first on Gizmodo Brasil. |

| Quatro indicações para você que está pensando em começar o seu próprio negócio Posted: 01 Nov 2019 01:41 PM PDT

Pensando nisso, em parceria com o Telecine, separamos algumas indicações para facilitar esse processo. Confira! CursoSe você quer ter o seu negócio, é preciso estudar. E muito. "O Fast MBA – Empreendedorismo, Negócios e Startups" da Udemy, maior plataforma de cursos online do mundo, te prepara para tirar uma ideia na cabeça e colocar no papel de forma estruturada e validada, diminuindo os riscos da falha. Você desenvolverá os principais requisitos para alavancar a sua empresa utilizando as ferramentas ideais para startups. A ideia é que você consiga criar, alavancar e gerir a sua empresa da melhor forma. FilmeSe você precisa se manter motivado, assista Vice, dirigido por Adam Mckay. O filme conta a trajetória de Dick Cheney, conhecido como o vice-presidente mais poderoso da história dos EUA. No time de George W. Bush, o empresário encabeçou políticas que impactam o mundo até os dias atuais. E o melhor: Vice está disponível na plataforma de streaming do Telecine. Dessa forma, você pode assistir do conforto da sua casa e a hora que quiser. Conheça o serviço! LivroA Startup Enxuta, escrito por Eric Ries, é aquele livro obrigatório para você que quer ter o seu próprio negócio. Sim, tem que ler. A obra explica como usar a inovação contínua para criar negócios radicalmente bem-sucedidos. De forma geral, a Startup Enxuta é um conjunto de práticas para criação de novos negócios de forma ágil, com baixos custos e orientada ao desejo dos clientes. O conceito que está por trás da obra é de, em vez de gastar muitos recursos (tempo, dinheiro e gente) planejando, pesquisando e desenvolvendo, buscar descobrir o que o mercado deseja, testando o mais cedo possível sua aceitação ao produto desenvolvido. Canal do YoutubeO canal da Endeavor no YouTube tem vários vídeos de capacitação e inspiração em moldes diversos – pílulas, mentorias, webséries, palestras…- para empreendedores. Nas playlists, você encontra a divisão tanto por formato quanto por tema. Isso sempre com grandes nomes de referência. Este conteúdo é apresentado pelo Telecine, única plataforma dedicada exclusivamente a filmes. E vale lembrar que agora o Telecine é bem mais do que canais na sua televisão. Ele é também streaming para você assistir ao filme que quiser, pelo dispositivo que quiser e onde quiser. Ao todo, o catálogo é formado por mais de 2.000 títulos, dos clássicos aos lançamentos saídos do cinema. Conheça os planos disponíveis e assine já! The post Quatro indicações para você que está pensando em começar o seu próprio negócio appeared first on Gizmodo Brasil. |

| Mais evidências sugerem que a moda neandertal incluía garras de águia Posted: 01 Nov 2019 01:13 PM PDT  Novas evidências fósseis sugerem que a prática neandertal de coletar garras de águia, que provavelmente eram usadas como joias ou usadas para criar símbolos poderosos, era mais extensa do que se pensava anteriormente. A datação desses artefatos sugere que os humanos modernos podem ter copiado essa prática. Evidências apresentadas nesta sexta-feira (1º) no Science Advances reforçam uma teoria que sugere que os neandertais usavam garras de águia como decorações simbólicas, podendo ter sido usadas como colares, brincos ou outras formas de adorno pessoal. Evidências dessa prática cultural entre os neandertais foram encontradas em outros lugares, mas a nova descoberta – um osso único de um pé de águia retirado da Caverna Foradada, na Espanha – é a primeira a ser encontrada na Península Ibérica. Além disso, com 39.000 anos, esse é possivelmente o exemplo mais “moderno” conhecido de uso de garras entre os neandertais, aparecendo no final de seu longo reinado. Dito isso, um antropólogo falou ao Gizmodo que não está claro se esses neandertais em particular usavam garras de águia por razões simbólicas ou decorativas, dizendo que são necessárias mais evidências. Que os neandertais fizeram suas próprias joias não é uma surpresa. Outras evidências arqueológicas sugerem que eles faziam pinturas rupestres e se decoravam com penas. Além disso, os humanos modernos que chegaram à Europa podem até ter adquirido parte de seu conhecimento tecnológico dos neandertais, incluindo o lissoir – um osso especializado para trabalhar com peles de animais duras. De forma fascinante, e como o novo artigo propõe, os humanos modernos também podem ter adotado a prática neandertal de usar garras de águia como joias.

Evidências sobre o uso de garras de águia entre os neandertais foram encontradas antes. Isso inclui sites arqueológicos na França e na Croácia, que datam de mais de 100.000 anos atrás. Pode-se dizer que os ancestrais mais antigos dos neandertais da Eurásia datam de 400.000 anos atrás. “Este artigo baseia-se em trabalhos anteriores, incluindo o meu, que mostram que os neandertais exploravam garras de raptores, presumivelmente por razões simbólicas”, disse Eugene Morin, antropólogo da Universidade Trent no Canadá e que não estava envolvido com o novo estudo, em um e-mail para o Gizmodo. "O que há de novo aqui é que, pela primeira vez, esse comportamento é documentado na Península Ibérica. O artigo também mostra que isso existia entre os neandertais châtelperronianos, provavelmente os últimos neandertais da região. Em outras palavras, o artigo estende a faixa geográfica e temporal para esse comportamento". De fato, o novo estudo, de coautoria de Antonio Rodríguez-Hidalgo, do Instituto de Evolução da África (IDEA), expande o período de tempo em que os neandertais coletavam garras de águia, um período que se estende de 130.000 a 39.00 anos atrás. Os neandertais foram extintos logo depois. “A evidência de comportamento simbólico – em enterros, arte ou adorno pessoal – entre espécies humanas arcaicas é escassa”, explicou Rodríguez-Hidalgo em um e-mail ao Gizmodo. "Cada nova descoberta é uma nova peça do grande quebra-cabeça. As descobertas da caverna de Foradada, na Espanha, representam o caso mais recente de uso de garras de águia como ornamentos pelos neandertais". É importante ressaltar que Rodríguez-Hidalgo e seus colegas não descobriram garras de águia na Caverna Foradada. Em vez disso, eles encontraram evidências indiretas na forma de uma única falange de águia, ou osso do dedo do pé, que teria sido parte de uma garra. Os cientistas documentaram marcas de corte específicas feitas neste osso como evidência de que os neandertais extraíram manualmente a garra, neste caso da perna esquerda de uma águia imperial espanhola.

É possível que os neandertais tenham feito essas marcas enquanto caçavam uma águia por comida, mas os autores descartaram isso devido à “completa falta de valor nutricional das extremidades inferiores de um pássaro”, segundo o novo artigo. Também é possível que as garras tenham sido usadas como ferramentas, como para perfurar, mas os autores acharam isso improvável. Os neandertais “usavam muito poucas ferramentas feitas com osso, pelo menos até onde sabemos”, disse Rodríguez-Hidalgo ao Gizmodo, acrescentando que os “neandertais escolheram as garras da águia, porque foi uma decisão deliberada, porque era importante escolher as águias por seu significado". John Stewart, professor associado de paleoecologia e mudança ambiental na Universidade de Bournemouth, que não participou da pesquisa, disse que um aspecto importante do estudo é que, até onde ele sabe, é a primeira vez que marcas de corte em ossos de pássaros são analisadas com uma tecnologia de digitalização desenvolvida pela bióloga Silvia Bellow do Museu de História Natural do Reino Unido. “Isso torna muito mais convincente do que as alegações sugeridas anteriormente”, disse Stewart ao Gizmodo. Os autores não sabem se essas garras foram usadas para criar colares ou se foram usadas como brincos ou pulseiras, mas esses ornamentos "transmitiam uma mensagem que os membros do grupo podiam entender e que outros neandertais, pelo menos do sul da Europa, podiam entender ", disse Rodríguez-Hidalgo. “Infelizmente, não temos uma Pedra de Roseta para decodificar essa mensagem”. David Frayer, antropólogo da Universidade do Kansas que não estava envolvido com a nova pesquisa, disse que estava “feliz” em ler sobre essa nova evidência, mas tinha algumas preocupações. Primeiro, alguns arqueólogos não estão convencidos de que a camada de Châtelperronian na Caverna Foradada possa estar ligada aos neandertais, “então este artigo não os influencia”, escreveu Frayer ao Gizmodo. Em segundo lugar, Frayer não estava empolgado com o fato de os autores não terem conseguido encontrar uma garra de águia real. Em 2015, Frayer e seus colegas fizeram exatamente isso, publicando um estudo detalhando a descoberta de várias garras de águia na caverna Krapina, na Croácia, datadas de 130.000 anos. As garras são “muito mais informativas”, disse Frayer, “mas isso foi apenas uma falange”. Por si só, as marcas de corte no osso do dedo do pé “não dizem muito sobre intenções simbólicas”. Sem outras evidências, Frayer “não está convencido de que sejam outra coisa além de marcas de caça, mas eu não sou especialista em marcas de corte no que se refere à caça”, disse ele. "Eu concordo que eles não estavam comendo águias, mas eu gostaria de ter visto mais. É uma pena que ainda não tenham encontrado garras na Caverna Foradada". De fato, mais evidências certamente ajudariam os autores a sustentar seu argumento, mas essa ainda é uma peça importante que pode ser adicionada ao quebra-cabeça. No total, os arqueólogos já coletaram 24 peças como esta, revelando o fascínio neandertal por essas aves majestosas. The post Mais evidências sugerem que a moda neandertal incluía garras de águia appeared first on Gizmodo Brasil. |

| Twitter diz que só vai sinalizar conteúdo abusivo se a denúncia for feita pela pessoa afetada Posted: 01 Nov 2019 11:09 AM PDT  Um usuário do Twitter relatou na quinta-feira (31) que, depois de sinalizar um tuíte abusivo, ele recebeu uma mensagem da rede social explicando que eles não podiam terminar de revisar o conteúdo para identificar possíveis violações dos Termos de Serviço até que “a pessoa diretamente afetada” pelo abuso o denunciasse. Em resumo, se você vir alguém insultando seu amigo, o Twitter não sinalizará o conteúdo até que seu amigo – e não você – denuncie o tuíte. O que parece implicar, como tuitou o usuário Jamie McGonnnigal, que “tudo bem alguém usar discurso de ódio, desde que não seja direcionado a você”.

Tradução: Para sua informação, o Twitter não permite mais denunciar posts homofóbicos/racistas/ofensivos a pessoas com deficiência/sexistas a menos que você esteja sendo diretamente atacado no tuíte. Você ainda pode denunciar, mas eles agora enviam essa mensagem. Então, tudo bem alguém usar discurso de ódio, desde que não seja direcionado a você". De acordo com suas regras, o Twitter define abuso como “uma tentativa de assediar, intimidar ou silenciar a voz de outra pessoa”, embora qualquer ameaça, com base na “inclusão em uma categoria protegida”, ou seja, raça, orientação sexual, gênero etc., é considerada conteúdo odioso. Ambos são proibidos na plataforma. No primeiro semestre deste ano, os usuários denunciaram 4,5 milhões de “contas únicas” por abuso e outros 5 milhões por conteúdo odioso, de acordo com o último relatório semestral de transparência do Twitter. O Twitter não respondeu imediatamente às perguntas do Gizmodo, portanto, não está claro se essa é uma política para toda a plataforma ou uma resposta específica direcionada ao tuíte relatado. Ultimamente, o Twitter vem adicionando muitas mudanças na área de publicidade, e não é preciso um grande palpite para pensar que isso possa se aplicar em toda a plataforma: quando você denuncia um tuíte por conteúdo abusivo, é solicitado que você selecione se é direcionado a você mesmo, a alguém que você representa legalmente ou a outros. Portanto, o Twitter já possui a infraestrutura para filtrar as denúncias com base em se elas afetam ou não o usuário. Infelizmente, seus termos de serviço oferecem algumas orientações confusas sobre o assunto. Veja este parágrafo abaixo, por exemplo:

É ridiculamente vago, o que pode ser intencional, uma vez que representa mais um obstáculo para os usuários conseguirem sinalizar com sucesso um abuso ou assédio. O próprio Twitter é construído em torno de gritar no vazio da Internet, então, por definição, tudo o que for publicado pode ser considerado parte de uma conversa maior. Essa política também parece condescendente com o usuário que denuncia o conteúdo, como se o Twitter estivesse argumentando que a pessoa simplesmente não entendeu a brincadeira ou referência. Além disso, na mesma página de Termos de Serviço, o Twitter afirma que “revisamos tanto as denúncias feitas pelas pessoas afetadas diretamente e por espectadores de tal conteúdo”, o que parece contradizer tudo isso. Embora eu não ficasse surpresa se o Twitter argumentasse que, tecnicamente, mesmo uma revisão inacabada ainda conta como revisão. Ironicamente, subtítulos nos regulamentos do Twitter simplificam a questão com frases do tipo “Como ajudar alguém que está sofrendo abuso online”, “Não seja apenas um espectador” e “Denuncie conteúdos a nós”. "Quando uma conta estiver particularmente assediando ou ameaçando, entre em contato conosco denunciando a conta ou os tuítes. Isso levará algumas etapas e sua denúncia nos ajudará a tornar o Twitter um lugar melhor", diz os Termos de Serviço do Twitter. Vou esperar ansiosamente que eles adicionem um asterisco um pouco maior depois disso. The post Twitter diz que só vai sinalizar conteúdo abusivo se a denúncia for feita pela pessoa afetada appeared first on Gizmodo Brasil. |

| Uma olhada de perto no Deep Fusion, o novo recurso de câmera do iPhone 11 Posted: 01 Nov 2019 09:47 AM PDT  Nesta semana, donos de iPhone 11 vão receber uma atualização grátis em suas câmeras graças a um motor neural e "ciência maluca". Na verdade, o nome do recurso é Deep Fusion, e foi feito para entregar fotos incrivelmente detalhadas, especialmente em ambientes desafiadores. Passei as últimas semanas testando uma versão beta do software de fotografia computacional da Apple em um iPhone 11 Pro e fiquei comparando com a de um iPhone 11 Pro convencional. A verdade é que ele funciona, mas só nos cenários mais estranhos. A primeira coisa que você precisa saber sobre o Deep Fusion é que a Apple tem muito orgulho do recurso. A empresa gastou vários minutos mostrando os recursos dele em seu evento de setembro, em que definiu o Deep Fusion como "a primeira vez que um mecanismo neural é responsável por gerar a imagem final de um app de câmera". Na prática, o processo consiste em fazer o iPhone tirar nove fotografias, e então o mecanismo neural do novo chip A13 Bionic essencialmente destaca os melhores pixels de cada imagem e "rearranja" a foto com mais detalhes e menos ruído comparado com um iPhone sem o recurso. Entendendo o Deep FusionPermita-me falar um pouco mais sobre o processo, pois não é tão confuso quanto parece. O que a câmera do iPhone faz com oito dessas nove exposições é parecido com bracketing, uma técnica antiga de fotografia onde você tira a mesma foto com diferentes configurações. Neste caso, a câmera do iPhone captura quatro quadros em exposição curta e quatro quadros de exposição padrão antes de você pressionar o botão do obturador. (A câmera do iPhone começa a capturar quadros de buffer assim que o app da câmera é aberto, caso precise deles para uma captura Deep Fusion ou Smart HDR.) Quando você pressiona o obturador, a câmera captura uma longa exposição que pega mais detalhes.

Todas essas exposições se tornam duas entradas para a ferramenta. A primeira entrada é o quadro de exposição curta com mais detalhes. A segunda é o que a Apple chama de "synthetic long" (longa sintética), resultando da fusão das fotos de exposição padrão com a longa exposição. Tanto o disparo de curta exposição quanto o longo sintético são alimentados na rede neural que os analisa em quatro bandas de frequência diferentes, cada uma mais detalhada que a anterior. A redução de ruído é adicionada a cada imagem e, finalmente, os dois são fundidos em uma base pixel por pixel. Todo esse processo leva cerca de um segundo, mas o aplicativo Câmera enfileira imagens proxy para que você possa continuar fotografando enquanto o mecanismo neural está funcionando, ou "deep fusioning" (fundindo de forma profunda, em tradução livre) todas as suas fotos. Qual a diferença entre Deep Fusion e HDR?Se você prestou muita atenção aos recursos de fotografia computacional da Apple, essa situação do Deep Fusion pode parecer muito com o recurso smart HDR lançado no ano passado com o iPhone XS. Em teoria é semelhante, já que o iPhone captura constantemente essas imagens de buffer antes que a foto seja tirada evitar o atraso de obturador. Na prática, no entanto, o Deep Fusion não está apenas destacando os realces e as sombras de diferentes exposições para capturar mais detalhes. Ele está trabalhando em um nível hípergranular para preservar os detalhes que os quadros individuais podem ter perdido. Ok, então talvez tudo isso seja meio complicado. Quando se trata de usar o novo iPhone com o Deep Fusion, você realmente não precisa pensar em como a mágica acontece, porque o dispositivo o ativa automaticamente. Há algumas coisas importantes a saber quando o recurso funciona e não funciona.

Há ainda mais um cenário em que é garantido que ele nunca funcione. Se você ativou a nova opção Composição nas configurações do aplicativo Câmera, que diz "Capturar fotos fora do quadro", o Deep Fusion nunca funcionará. Portanto, mantenha essa opção desativada se você quiser experimentar o Deep Fusion. Deep Fusion na práticaAgora que todos os detalhes técnicos estão fora do caminho, vamos descobrir como é realmente a "ciência louca" da fotografia computacional do Deep Fusion. Logo após o recurso Deep Fusion aparecer na versão beta pública do iOS 13.2, instalei o software no iPhone 11 Pro do Gizmodo, enquanto mantive a versão anterior do iOS sem Deep Fusion no meu iPhone 11 Pro. Depois, tirei um monte de fotos dos mais diversos ambientes. Francamente, muitas vezes não conseguia diferenciar entre a foto composta via Deep Fusion e a foto que não usa a ferramenta. Dê uma olhada nessas duas fotos do relógio (abaixo) no meio do Grand Central Terminal, cada uma tirada com a câmera telefoto de um iPhone 11 Pro. Você conseguiria dizer qual foi tirada com Deep Fusion e qual não foi? Se você quiser entender os símbolos básicos que inclui no canto de cada foto, você provavelmente conseguirá decifrar. Caso contrário, dará muito trabalho para discutir. O fato é que tem uma diferença. Dê uma olhada nos números do relógio. Eles têm definição melhor na foto Deep Fusion. O mesmo acontece com as ondulações na bandeira americana e as texturas dos pilares de pedra ao redor dela. Você pode não notar que a foto sem o recurso está um pouco confusa nessas áreas, mas quando você vê a foto com Deep Fusion é possível ver que os detalhes são um pouco melhores.

Sutil, não? Mas neste caso, mesmo sem dar zoom, alguém pode claramente ver como as fotos com Deep Fusion têm menos ruído. As duas fotos mostram a impressionante performance do iPhone 11 Pro em cenários com pouca luz. O saguão principal do Grand Central Terminal é um local surpreendentemente escuro, especialmente ao entardecer, quando essas fotos foram tiradas. Ambas são bonitas, mas as com a novidade são um pouco melhores. Agora, vamos olhar um exemplo diferente. Aqui (abaixo) uma foto tediosa e cheia de detalhes de um arranha-céu de Manhattan em um dia escuro e chuvoso. Neste caso, você precisa dar um zoom para ver algumas das diferenças sutis entra a foto do iPhone 11 Pro e a do aparelho com Deep Fusion. Elas são muito parecidas. Você notará um pouco menos de ruído, e os reflexos na janela são mais claros na imagem da direita. A maior diferença que eu consigo ver está no parapeito branco no lado direito na parte de baixo do quadro. Parece quase borrado na foto que não é Deep Fusion. E, assim como os números do relógio da foto do Grand Central, a grade branca aparece na foto com Deep Fusion.

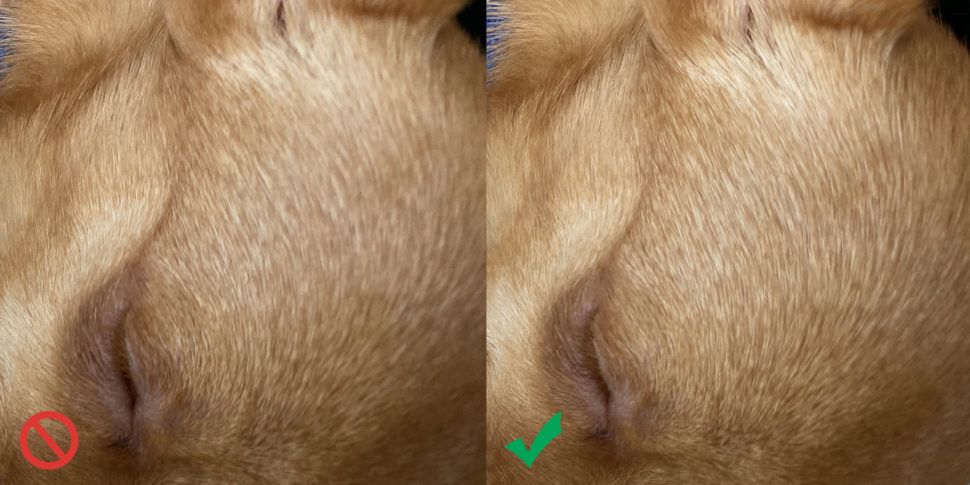

Este exercício de olhar para diferenças foi o que mais fiz nesse tempo testando a câmera com Deep Fusion contra a que não tinha. Ambas tiram fotos impressionantes, e o aparelho com Deep Fusion ocasionalmente tirava fotos melhores em determinados ambientes. Mais uma vez, o recurso funciona apenas em ambientes com pouca luz com a câmera grande angular e geralmente funciona em fotos tiradas com a lente telefoto, a menos que a cena esteja muito clara. As coisas mudaram para mim quando comecei a tirar fotos de peles. Em teoria, esse é o tipo exato de cenário em que o Deep Fusion deve brilhar, já que pequenos fios de cabelo tendem a ficar embaçados, mas um mecanismo neural pode identificar esses detalhes e fundi-los em uma foto do Deep Fusion. Talvez por isso, a Apple tenha escolhido usar um homem barbudo em um suéter de textura fina para exibir o Deep Fusion durante sua apresentação em setembro. Minha versão de um homem barbudo com suéter de textura final é uma cachorrinha chamada Peanut.

Fofa, né? A Peanut pesa pouco mais de 1 kg e é coberta pela mais macia e fina pelagem castanha. Cada pelo tem uma cor ligeiramente diferente, o que quase faz parecer que ela fazer luzes em um salão de beleza para cachorros. Embora ela pareça angelical nessas duas fotos, é bastante fácil ver que, na foto à esquerda, seus pequenos destaques suaves ficam embaçados no alto da cabeça e na orelha. Na foto com Deep Fusion à direita, elas são muito nítidas. Dê uma olhada de perto:

Neste caso, a foto que não possui os poderes do Deep Fusion parece meio desfocada em determinados lugares. E quanto mais você aumenta o zoom, mais fica claro o poder do Deep Fusion. Dito de outra forma, nunca mais quero tirar outra foto da Peanut sem essa ferramenta. Isso me leva a uma peça curiosa do quebra-cabeça do Deep Fusion. Ele é um quebra-cabeças, pois o fluxo de trabalho dele é confuso e, nos meus testes, às vezes era confuso dizer quando a tecnologia estava funcionando. Também é um enigma, porque essas sutilezas parecem irrelevantes nesta primeira iteração do recurso. Por exemplo, se o Deep Fusion funcionava apenas ocasionalmente e apenas de maneiras muito específicas, por que a Apple fez tanto barulho sobre ele no evento e por que demorou mais de dois meses para que fosse disponibilizado ao público? Na verdade, não sei as respostas destas perguntas, embora eu tenha uma teoria. Minha tese é que o Deep Fusion é um uma das tecnologias mais sofisticadas de fotografia computacional que a Apple já desenvolveu, e no momento, estamos vendo os primeiros frutos de suas capacidades. Posso ver um futuro no qual a Apple se baseia no Deep Fusion e cria recursos muito mais impressionantes. Os recursos de fotografia no Google Pixel 4 — ou seja, Super Res Zoom — podem até oferecer um vislumbre desse futuro. O zoom Super Res do Google combina o zoom óptico e digital no Pixel 4 para oferecer fotos com zoom super nítido. Se a Apple já está explorando maneiras de fundir imagens para obter mais detalhes, eu poderia imaginar que a empresa poderia procurar maneiras de melhorar ainda mais seus recursos de zoom, especialmente agora que há um iPhone com três câmeras na parte traseira. Mas isso tudo é conjectura. Por enquanto, não importa se o Deep Fusion te impressiona ou não. Se você tem um iPhone 11 ou um iPhone 11 Pro, você recebe o recurso gratuitamente ao atualizar para o iOS 13.2. Se você tiver um telefone mais antigo, você não deve receber o Deep Fusion. O recurso certamente evoluirá, e o que veremos no próximo ano provavelmente será mais impressionante do que o que está disponível agora. Dito isto, as câmeras presentes no iPhone 11 e no iPhone 11 Pro são bem impressionantes. Você pode trocar de telefone apenas para ter o sensor ultra-grande angular, que vem nos modelos lançados neste ano. Só posso dizer que estou me divertindo muito com este sensor. Vide esta foto abaixo:

The post Uma olhada de perto no Deep Fusion, o novo recurso de câmera do iPhone 11 appeared first on Gizmodo Brasil. |

| Google confirma aquisição da fabricante de pulseiras inteligentes Fitbit por US$ 2,1 bilhões Posted: 01 Nov 2019 08:23 AM PDT  Após os rumores que surgiram no início desta semana, o Google finalmente confirmou que vai adquirir a Fitbit por US$ 2,1 bilhões. A fabricante conhecida por suas pulseiras e relógios inteligentes será incorporada à gigante de tecnologia, juntando-se à equipe de hardware da empresa. De acordo com as declarações das duas companhias, parece que os futuros wearables vão utilizar o sistema Wear OS. Mesmo com a aquisição, a Fitbit afirma que os seus produtos continuarão trabalhando com dispositivos iOS e Android no futuro. O Google afirmou em um comunicado publicado em seu blog que a empresa se mantém "comprometida com o Wear OS e com nosso ecossistema de parceiros, e planejamos trabalhar próximos à Fitbit para combinar o melhor das nossas respectivas plataformas para smartwatch e fitness tracker". A companhia também garantiu que os dados coletados pelas pulseiras inteligentes não serão utilizados para anúncios, embora tenha alertado que haverá uma coleta de dados, assim como ocorre em outras plataformas. "Similar aos nossos outros produtos, com os wearables, seremos transparentes sobre os dados que coletamos e por quê. Nós jamais venderemos informações pessoais. Os dados de saúde e bem-estar da Fitbit não serão utilizados para anúncios do Google. E nós daremos aos usuários da Fitbit a opção de revisar, mover ou apagar seus dados", afirma a empresa no comunicado. Por enquanto, não há detalhes sobre como serão os futuros dispositivos lançados como resultado dessa aquisição. Porém, esse plano do Google de unir o melhor dos dois mundos terá que ser muito bem executado para competir em um mercado crescente de pulseiras e relógios inteligentes, e que já oferece desde o sofisticado Apple Watch ao acessível Mi Band. Recentemente, até a Motorola anunciou que vai reviver seu Moto 360. The post Google confirma aquisição da fabricante de pulseiras inteligentes Fitbit por US$ 2,1 bilhões appeared first on Gizmodo Brasil. |

| Posted: 01 Nov 2019 07:58 AM PDT  Os jogos de videogame mais recentes dão aos jogadores mais liberdade para explorar mundos digitais complexos. Por isso, é cada vez mais desafiador para um personagem gráfico criado em computador se mover e interagir naturalmente com tudo que existe virtualmente ao seu redor. Portanto, para evitar essas transições lamentáveis entre movimentos pré-programados, os pesquisadores recorreram à inteligência artificial e ao deep learning para fazer com que os personagens se movam de uma maneira quase tão realística quanto os humanos. Para ajudar os personagens a andar, correr, pular e executar outros movimentos da maneira mais realista possível, os desenvolvedores geralmente se baseiam em performances humanas, que são capturadas e traduzidas para personagens digitais. Isso produz resultados mais rápidos e mais bonitos do que fazer as animações manualmente, mas é impossível planejar todas as maneiras possíveis de um personagem interagir com o mundo digital, de acordo com os pesquisadores. Os desenvolvedores tentam planejar o maior número de possibilidades, mas, no final das contas, precisam confiar no software para fazer a transição entre, por exemplo, as animações de um personagem andando até uma cadeira e, em seguida, sentando-se nela. Na maioria das vezes, esses segmentos parecem toscos e antinaturais, o que pode atrapalhar a experiência de quem está jogando. Cientistas da computação da Universidade de Edimburgo e da Adobe Research trouxeram uma nova solução que será apresentada na conferência ACM Siggraph Asia, realizada em Brisbane, na Austrália, no próximo mês. E, como muitas inovações que surgiram antes, ela envolve alavancar as capacidades das redes neurais de aprendizado profundo para suavizar os engasgos de animação que os videogames exibem atualmente. Para criar os vídeos deepfake convincentes, mas perturbadores, que estão por toda a internet agora, uma rede neural é treinada primeiro estudando o rosto de uma determinada pessoa (geralmente uma celebridade) de todos os ângulos possíveis e com todas as expressões imagináveis usando um banco de dados de dezenas de milhares de fotos na cabeça do sujeito. É um processo demorado, mas, com esse conhecimento, é possível criar automaticamente trocas de rosto de modo que elas pareçam inacreditavelmente realistas. Uma abordagem semelhante está sendo adotada para esta pesquisa. No entanto, em vez de treinar uma rede neural em um banco de dados de rostos, ela estuda uma coleção de movimentos capturados e digitalizados de um artista ao vivo em um palco. Para obter os melhores resultados, é necessário um banco de dados de movimentos bastante grande para o sistema analisar, com um ator passando pelos movimentos de pegar objetos, escalar coisas ou sentar-se em uma cadeira. Mas essa variedade não precisa incluir todas as possibilidades, pois a rede neural pode pegar o que aprendeu e adaptar a praticamente qualquer situação ou ambiente. Assim, ela produz resultados e movimentos com aparência natural, de acordo com os pesquisadores. Isso preenche as lacunas entre o movimento de andar até a cadeira, diminuir a velocidade, virar o corpo e depois sentar, mas, ao mesmo tempo, vincular inteligentemente todos esses movimentos e animações para ocultar as costuras. Existem outras vantagens em ensinar aos videogames como os personagens devem se mover e interagir com as coisas, em vez de pré-animar esses movimentos, como ajudar a reduzir o tamanho dos arquivos dos jogos e a quantidade de dados que precisam ser processados e compartilhados. Isso vai se tornar ainda mais relevante à medida que o streaming de jogos ficar mais popular. Essa abordagem também abre caminho para interações mais complexas entre os personagens de videogame. Com que frequência você vê mais de dois personagens acabando brigando? Nunca, exceto em cenas pré-animadas. Assim, quem sabe a próxima versão do Red Dead Redemption não possa finalmente incluir brigas reais em bares? The post Pesquisadores usam inteligência artificial para criar personagens de videogame que se movem de maneira mais realística appeared first on Gizmodo Brasil. |

| Serviço de streaming Apple TV+ já está disponível por R$ 9,90, com teste grátis de 7 dias Posted: 01 Nov 2019 07:17 AM PDT  Entramos no mês de novembro e isso significa que temos mais uma opção de serviço de streaming para assinar. A Apple TV+ está oficialmente disponível para quem quiser assistir aos conteúdos previamente anunciados, entre eles: The Morning Show, See e For All Mankind. A mensalidade é de apenas R$ 9,90 e é possível testar o serviço gratuitamente por sete dias. O valor da assinatura é um grande atrativo, mas o catálogo também é mais limitado. Ainda assim, essa é a estreia da plataforma e o catálogo deve aumentar com o tempo. Além disso, os conteúdos originais receberam um grande investimento e contam com um elenco de peso, o que pode ser um diferencial para o TV+. Por enquanto, apenas os primeiros episódios de programas como The Morning Show e See estão disponíveis; os próximos serão lançados semanalmente. A Apple ainda prometeu que a maioria dos conteúdos seria oferecida em 4K, com Dolby Vision HDR e áudio Dolby Atmos. Usuários de iOS e macOS ainda poderão fazer o download dos vídeos para assistir offline. Além dos dispositivos Apple, é possível assistir ao TV+ acessando o site do serviço pelo navegador. A empresa ainda disse que futuramente o aplicativo estará disponível para algumas smart TVs da Samsung, além de plataformas como Amazon Fire TV, LG, Roku, Sony e VIZIO. Quem adquirir um novo produto da Apple ganha um ano de assinatura gratuita. Ainda não há informações sobre como a companhia pretende controlar o compartilhamento de contas, mas cada assinatura permite criar até seis perfis por meio do Compartilhamento Familiar, sendo que cada um pode ser configurado de acordo com as preferências dos usuários. É possível conferir os conteúdos disponíveis e começar o teste gratuito de sete dias aqui – é preciso fornecer seu Apple ID ou criar um. Para quem já tem algum produto da Apple, basta abrir o aplicativo Apple TV que já vem instalado nos dispositivos. [Engadget] The post Serviço de streaming Apple TV+ já está disponível por R$ 9,90, com teste grátis de 7 dias appeared first on Gizmodo Brasil. |

| Samsung coloca telas QLED em novos notebooks da linha Galaxy Book Posted: 01 Nov 2019 06:22 AM PDT  A Samsung sabe que seus laptops recentes não tiveram o impacto desejado. Por isso, para a próxima linha, a empresa resolveu tentar algo novo: pegar emprestada a tecnologia de display QLED usada nas suas TVs de ponta e colocá-la no Galaxy Book Flex e no Galaxy Book Ion, que ainda serão lançados. A Samsung afirma que esta é a primeira vez que uma empresa coloca a tecnologia QLED em um laptop. Com seus novos monitores, a companhia diz que seus laptops podem oferecer brilho máximo de até 600 nits (a maioria dos laptops chega a 300 ou 350 nits).

Pessoalmente, a diferença é óbvia. Quando comparado lado a lado com um Samsung Notebook 9 do ano passado, a tela do Galaxy Book Flex era visivelmente mais brilhante e mais vibrante. No entanto, devo mencionar que, para obter os 600 nits de brilho completos do Galaxy Book Flex, é necessário ativar o modo externo, que fica separado das configurações de brilho. Com um acabamento azul deslumbrante, chassi de alumínio e dobradiça 2 em 1 de 360 graus, o Galaxy Book Flex é o mais premium dos dois. O Galaxy Book Flex vem com várias opções de processadores Intel Ice Lake de 10ª geração, até 16 GB de RAM e SSDs NVMe de 1 TB. No entanto, as telas QLED não foram a única peça que a Samsung pegou emprestada de outra divisão de produtos. O Galaxy Book Flex tem uma caneta S Pen trazida da linha Galaxy Note. O Galaxy Book Flex e o Ion também têm com alguns recursos relacionados a smartphones, como um sensor de impressão digital dedicado para logins biométricos rápidos e um carregador sem fio que fica embaixo do touchpad do sistema. É uma escolha esquisita, porque isso significa que você não pode carregar seu celular ali e usar o touchpad ao mesmo tempo. Para ligar o carregador sem fio, você precisa desativar o touchpad usando um atalho de teclado. A Samsung diz que a razão disso é porque o corpo metálico do Galaxy Book Flex bloqueia o carregamento sem fio. Isso é verdade, mas não resolve o problema. Além disso, o Galaxy Book Ion tem possui um corpo de plástico.

Falando do Galaxy Book Ion, embora seja apenas um laptop que abre e fecha do jeito convencional, o que falta em flexibilidade sobra em portabilidade. O modelo de 13 polegadas pesa menos de um quilo (0,97 kg versus 1,15 kg do Galaxy Book Flex de 13 polegadas). No entanto, o Galaxy Book Ion também vem com desempenho ligeiramente reduzido, graças a uma variedade de processadores Intel Comet Lake de 10a geração, em vez de chips baseados no Ice Lake. Felizmente, as versões de 13 e 15 polegadas de ambos os sistemas vêm com um bom conjunto de portas, que inclui uma Thuderbolt 3, duas USB-A 3.0 padrão, uma HDMI de tamanho normal e um slot para cartão microSD. E se você precisar de um pouco mais de desempenho gráfico, os modelos de 15 polegadas podem ser configurados com placas dedicadas MX250 da Nvidia em vez da Intel UHD padrão ou da Intel Iris Plus do Galaxy Book Flex. Infelizmente, ainda demorará muito para que os novos laptops da Samsung cheguem ao mercado. A empresa diz apenas que o Galaxy Book Flex e o Galaxy Book Ion estarão disponíveis em algum momento no primeiro semestre de 2020. The post Samsung coloca telas QLED em novos notebooks da linha Galaxy Book appeared first on Gizmodo Brasil. |

| Pesquisa mostra que um embrulho mal-feito vai fazer a pessoa gostar mais do seu presente Posted: 01 Nov 2019 04:14 AM PDT  O período de festas está se aproximando, mas, de acordo com um estudo publicado no Journal of Consumer Psychology, você não deve perder seu tempo embrulhando impecavelmente os presentes que comprou – as pessoas estão mais inclinadas a gostar do que está dentro se os presentes forem mal embalados. A suposição comum é que, se alguém lhe entregar um presente que parece como se a pessoa tivesse passado uma semana embrulhando perfeitamente, o que está dentro deve ser espetacular para justificar todo o esforço. É exatamente o que acontece, mas essa suposição pode realmente ser um prejuízo para quem está entregando o presente, porque um trabalho meticuloso de embrulho aumenta as expectativas sobre o próprio presente, o que mais frequentemente leva à decepção. Para testar essa hipótese, pesquisadores e professores da Universidade de Nevada, Reno, especializados em marketing, pediram a um grupo de participantes do estudo para abrir um presente que fosse embrulhado com imenso cuidado ou desleixadamente. Todos os participantes foram escolhidos especificamente porque se identificaram como fãs do time de basquete do Miami Heat, mas dentro dos presentes embrulhados havia uma caneca do Miami Heat, que seria ostensivamente preferida pelos fãs do time, ou uma caneca com o logotipo do Orlando Magic. Depois de abrir o presente, cada participante classificou-o, respondendo a uma série de cinco perguntas, e os resultados do estudo revelaram surpreendentemente que o presente embrulhado desleixadamente foi melhor recebido em geral, mesmo pelos fãs do Miami Heat que encontraram uma caneca do Orlando Magic. Para confirmar suas descobertas, os pesquisadores realizaram outro experimento em que um grupo de participantes recebeu imagens de presentes embrulhados de maneira agradável ou desleixada e, em seguida, perguntou quais eram suas expectativas sobre o que havia dentro. Quando o conteúdo do presente foi revelado aos participantes (um par de fones de ouvido JVC), eles avaliaram se o presente correspondia ou não às expectativas relatadas anteriormente. O segundo experimento constatou que as expectativas para a versão bem embrulhada do presente eram muito mais altas, mas o presente em si foi classificado como menos favorável pelos que viram as imagens da melhor embalagem. No entanto, talvez você não queira embalar de qualquer jeito todos os presentes que planeja dar durante as festas. Pode ser uma tática útil para amigos e familiares que sabem que você já gosta deles, mas um terceiro experimento realizado pelos pesquisadores descobriu que há uma chance maior de que um conhecido (onde um relacionamento favorável seja menos estabelecido) goste do presente quando estiver embrulhado de maneira bem feita, pois o tempo extra e os cuidados tomados são uma indicação de que o doador de presentes vê o relacionamento como importante e que vale a pena continuar. Se você precisar dar um presente em uma festa do escritório, reserve alguns minutos extras para garantir que tudo seja feito da maneira certa. Mas quando se trata de seus amigos e familiares, não se preocupe com cortes tortos, padrões desalinhados e laços que fazem parecer que você nem sabe amarrar os sapatos. The post Pesquisa mostra que um embrulho mal-feito vai fazer a pessoa gostar mais do seu presente appeared first on Gizmodo Brasil. |

| You are subscribed to email updates from Gizmodo Brasil. To stop receiving these emails, you may unsubscribe now. | Email delivery powered by Google |

| Google, 1600 Amphitheatre Parkway, Mountain View, CA 94043, United States | |

Começar a empreender não é uma tarefa fácil. Pelo contrário: o caminho é repleto de dificuldades. Talvez você tenha várias ideias, mas tirá-las do papel parece um passo (bem) à frente. Ou ainda pode não se sentir seguro para gerir o negócio. Ou, simplesmente, não sabe nem por onde começar.

Começar a empreender não é uma tarefa fácil. Pelo contrário: o caminho é repleto de dificuldades. Talvez você tenha várias ideias, mas tirá-las do papel parece um passo (bem) à frente. Ou ainda pode não se sentir seguro para gerir o negócio. Ou, simplesmente, não sabe nem por onde começar. O osso da águia com marcas de corte. Imagem: Antonio Rodríguez-Hidalgo

O osso da águia com marcas de corte. Imagem: Antonio Rodríguez-Hidalgo Imagens do osso do dedo do pé e marcas de corte associadas. Imagem: A. Rodríguez-Hidalgo et al., 2019/Science Advances

Imagens do osso do dedo do pé e marcas de corte associadas. Imagem: A. Rodríguez-Hidalgo et al., 2019/Science Advances Captura de tela

Captura de tela Foto: Adam Clark Estes/Gizmodo

Foto: Adam Clark Estes/Gizmodo

Foto: Adam Clark Estes/Gizmodo

Foto: Adam Clark Estes/Gizmodo Foto: Adam Clark Estes/Gizmodo

Foto: Adam Clark Estes/Gizmodo Foto: Adam Clark Estes/Gizmodo

Foto: Adam Clark Estes/Gizmodo O Galaxy Book Flex de 15 polegadas está à esquerda, e o Notebook 9 do ano passado está à direita. Foto: Sam Rutherford/Gizmodo

O Galaxy Book Flex de 15 polegadas está à esquerda, e o Notebook 9 do ano passado está à direita. Foto: Sam Rutherford/Gizmodo

É irritante, mas, por causa da localização da bobina de carregamento sem fio, você não pode carregar o celular e usar o touchpad do Galaxy Book Flex ou do Galaxy Book Ion ao mesmo tempo. Foto: Sam Rutherford/Gizmodo

É irritante, mas, por causa da localização da bobina de carregamento sem fio, você não pode carregar o celular e usar o touchpad do Galaxy Book Flex ou do Galaxy Book Ion ao mesmo tempo. Foto: Sam Rutherford/Gizmodo

Nenhum comentário:

Postar um comentário